Xiomara Patricia Blanco Valencia/ Óscar De Gregorio Vicente

Una herramienta en continuo desarrollo, con un enfoque multidisciplinar que combina tecnología, ciencias sociales y políticas públicas, y que es clave para abordar eficazmente el discurso de odio en esta sociedad digital y conectada.

Un mensaje de odio, aplicado al contexto de las redes sociales y los medios de comunicación digitales, puede derivar en delito de odio si concurren los diferentes factores que lo constituyen. Así, la OSCE (Organización para la Seguridad y la Cooperación en Europa), entiende como delito de odio “cualquier delito penal contra las personas y/o propiedades, donde las víctimas u objetos de la infracción son seleccionados por su conexión, relación, afiliación, apoyo o pertenencia real o percibida a un grupo basado en la raza, origen nacional o étnico, el idioma, el color, la religión, la edad, la discapacidad física o mental, la orientación sexual u otro factor similar” (Fuente: ONDOD (Oficina Nacional de lucha contra los delitos de odio).

Esta definición establece un contexto para comprender cómo el odio puede manifestarse en acciones concretas que constituyen delitos. Por tanto, es importante identificar y detectar una posible tendencia de escalada en un entorno de comunicación u opinión, en el que se pase de una discusión a la utilización de un lenguaje ofensivo, y de aquí a un discurso de odio que puede ser precursor de estos delitos, creando un ambiente de hostilidad y discriminación hacia determinados grupos.

Es importante destacar que el discurso de odio no solo causa daño directo a sus víctimas, sino que también erosiona los valores democráticos, la cohesión social y puede conducir a la normalización de la discriminación y la violencia. Por ello, su monitorización y prevención son fundamentales para proteger los derechos humanos y promover una sociedad inclusiva.

¿Qué es el Monitor de Odio?

Por tanto, queda justificada la necesidad de dar respuesta a la creciente preocupación por el impacto de los discursos de odio en la sociedad, y contar con un mecanismo efectivo que sea capaz de monitorizar, analizar, prevenir y alertar de escaladas en redes sociales y medios digitales de comunicación. El Monitor de Odio utiliza tecnologías avanzadas de procesamiento de lenguaje natural y análisis de datos para examinar contenidos en medios digitales y detectar expresiones que puedan constituir discurso de odio, incluso delitos de odio.

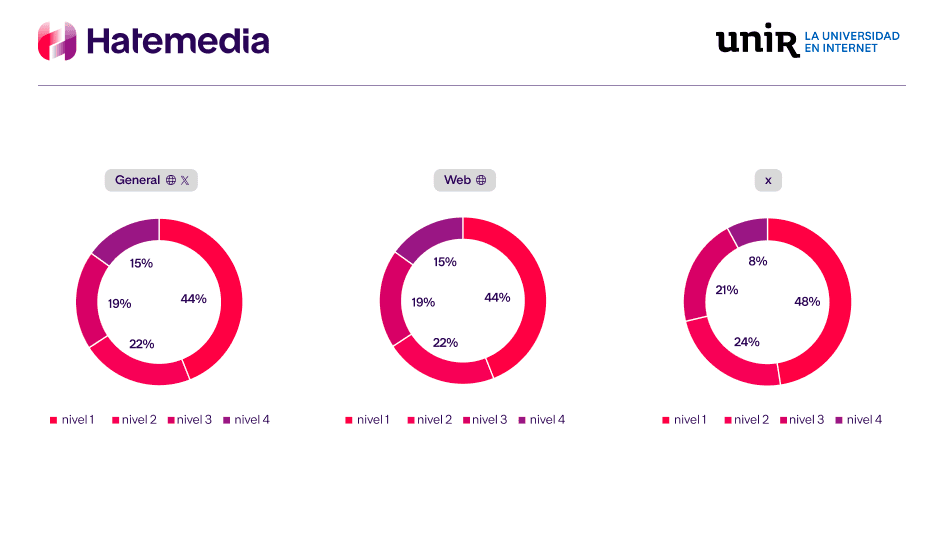

La herramienta identifica la presencia de discurso de odio en los mensajes, y clasifica su tipología (político, misógino, sexual, xenófobo y general) e intensidad (1=incívicos, 2=mal intencionados o abusivos, 3=insultos y 4=amenazas veladas o explícitas), proporcionando un análisis detallado que permite comprender mejor este fenómeno y desarrollar estrategias efectivas para su prevención.

De esta forma, en un contexto donde la desinformación y los mensajes de odio pueden propagarse rápidamente a través de plataformas digitales, esta herramienta proporciona un sistema de alerta temprana que permite identificar patrones y tendencias en el discurso público.

¿Cómo funciona?

El Monitor de Odio emplea una metodología rigurosa y sistemática para la detección y análisis del discurso de odio en medios digitales. El proceso se estructura en varias etapas interconectadas que permiten un análisis exhaustivo y preciso.

Para el desarrollo del Monitor de Odio, se toman los cinco medios informativos digitales, considerados en el proyecto Hatemedia (PID2020-114584GB-I00), financiado por la Agencia Estatal de Investigación – Ministerio de Ciencia e Innovación: 20 Minutos, ABC, El Mundo, La Vanguardia, y El País. Se realiza una recopilación de los mensajes o discursos (en español) de estos medios en redes sociales y plataformas digitales, que son almacenados siguiendo la normativa vigente en materia de seguridad y protección de datos. Posteriormente se procesan mediante algoritmos de análisis de texto que identifican patrones lingüísticos asociados con el discurso de odio.

Se aplican técnicas de clasificación para categorizar el contenido, según su tipología e intensidad, mediante modelos entrenados con ejemplos previamente etiquetados por expertos en la materia (lingüistas, semiólogos, comunicadores, etc.).

A cada mensaje analizado, se le asignan unos pesos o ponderaciones de base, en función del tipo y la intensidad (factores), los cuales son el resultado de consultas a un comité de expertos en el ámbito de la investigación. Dichas ponderaciones asignadas a cada factor son configurables, lo que permite adaptar la monitorización en cada momento dependiendo del entorno de aplicación. Por ejemplo, en un contexto electoral sería razonable aplicar una mayor ponderación a los mensajes de odio de tipo político por las implicaciones sociales y de polarización intencionada hacia determinado/s partido/s, derivadas tanto de posibles injerencias internas como externas. Así, el Monitor se amolda a diferentes contextos y necesidades específicas.

Los resultados del Monitor son integrados en un Índice de Alerta Temprana (dashboard), que proporciona una medida sintética cuantitativa única del nivel de discurso de odio presente en los medios analizados. El cálculo del índice se basa en una media ponderada de cada registro o mensaje de odio detectado.

De esta forma, este índice permite monitorizar la evolución de los discursos de odio detectados, identificando el fenómeno a lo largo del tiempo y alertando de incrementos significativos que puedan requerir atención o acciones inmediatas. (Imagen: posible desarrollo del Monitor).

Por tanto, el Índice de Alerta Temprana enlaza con el Monitor de Odio, como herramientas resultantes para la detección y clasificación del discurso de odio en los medios digitales monitorizados.

¿Cuál es su utilidad?

Su capacidad para monitorizar la evolución del discurso de odio a lo largo del tiempo permite detectar tendencias, picos y patrones que pueden ser indicativos de problemas emergentes o de la efectividad de las medidas implementadas para combatir este fenómeno.

Así, se identifican qué tipos de discurso de odio son más prevalentes en determinados contextos o períodos, facilitando el desarrollo de estrategias específicas para abordar y evitar cada forma de discriminación.

Sus principales fortalezas o utilidades incluyen:

- Monitorización a través de un frontend adaptable y escalable, según las necesidades específicas de diferentes contextos y usuarios.

- Capacidad para analizar grandes volúmenes de datos gracias a un backend que permite un procesamiento distribuido, y una cobertura amplia y representativa.

- Clasificación detallada por tipos e intensidades de los discursos de odio, facilitando un análisis más profundo y específico del fenómeno.

- Seguimiento de la evolución temporal, permitiendo identificar tendencias, patrones y situaciones que requieren atención inmediata.

- Estimación a futuro en base a tendencias, patrones y perfiles previos.

- Identificación efectiva de los delitos de odio y coordinación con las entidades oficiales correspondientes (p.e. Fiscalía), para actuar en consecuencia.

Entre los posibles usuarios potenciales de estas herramientas se encuentran:

- Medios informativos digitales (editores, directores, community managers) para monitorizar y gestionar el contenido de sus plataformas.

- Agencias de comunicación encargadas de la gestión de los usuarios sociales vinculados a estos medios informativos, a través de redes sociales.

- Instituciones públicas y organizaciones de la sociedad civil, para el desarrollo de políticas y estrategias contra el discurso de odio: Ministerio del Interior, Ministerio de Justicia, Cuerpos y Fuerzas de Seguridad del Estado, ONDOD, OSCE, etc.

- Entidades educativas, para sensibilizar sobre el impacto del discurso de odio y promover un uso responsable del lenguaje y las plataformas digitales.

- Equipos de investigación, para avanzar en las líneas actuales de análisis e interpretación de la dinámica y evolución del discurso de odio en entornos digitales.

Conclusiones

Es importante destacar que el Monitor de Odio no pretende clasificar a los medios de comunicación en función de su calidad o rigor periodístico, sino proporcionar una herramienta de identificación y análisis del discurso de odio en sus contenidos.

Por tanto, los resultados del monitor deben interpretarse considerando diversos factores contextuales, como el volumen de contenido analizado, el período temporal, los eventos sociales, culturales, deportivos, religiosos o políticos relevantes durante ese período, y las características específicas de cada medio.

Es fundamental entender que la presencia de discurso de odio en un medio no implica necesariamente que ese medio promueva activamente tales discursos. Puede reflejar la cobertura de eventos donde estos discursos están presentes, o la inclusión de opiniones diversas. Por ello, los resultados deben interpretarse con cautela y en su contexto adecuado. Además, tal y como el equipo del proyecto ha indicado en artículos precedentes, las técnicas para la difusión del discurso de odio han evolucionado, y así mismo deben evolucionar las herramientas para su detección y mitigación, contando siempre con la supervisión humana, y prestando especial atención para evitar posibles sesgos o limitaciones de la libertad de expresión.

La primera versión del Monitor de Odio, actualmente en desarrollo, busca continuidad, y se espera poder mejorar y ampliar sus capacidades en futuras iteraciones, incorporando nuevas fuentes de datos, refinando los algoritmos de detección y clasificación, y adaptándose a la evolución del fenómeno del discurso de odio en entornos globales.

El desarrollo continuo de estas herramientas, junto con un enfoque multidisciplinar que combine tecnología, ciencias sociales y políticas públicas, será fundamental para abordar eficazmente el desafío que representa el discurso de odio en nuestras sociedades digitalmente conectadas.

Glosario de términos:

- Community manager: Profesional que gestiona y modera comunidades en redes sociales y otros espacios digitales, interactuando con usuarios.

- Dashboard: Panel de control que nos permite visualizar rápidamente y de forma comprensible datos y métricas relevantes.

- Frontend: Interfaz gráfica de usuario de una aplicación o sitio web.

- Backend: Parte interna de una aplicación o sitio web que gestiona la lógica del negocio y gestión del dato.

(*) Xiomara Patricia Blanco Valencia es doctora en Informática y Automática por la Universidad de Salamanca-USAL y tiene un Máster en Sistemas Inteligentes por la USAL. Docente e investigadora de UNIR. Profesora de Aprendizaje Automático, Business Intelligence, Gobierno del Dato, Sistemas Cognitivos Artificiales, Sistemas Inteligentes en UNIR. Investigadora en áreas como el aprendizaje supervisado y el no supervisado, el aprendizaje profundo y el procesamiento del lenguaje natural. Cuenta con más de 15 años de experiencia en desarrollo de software y administración de bases de datos.

(*) Óscar de Gregorio Vicente es doctor en Ingeniería Matemática, Estadística e Investigación Operativa por la UCM y la UPM, y tiene un Máster en Educación del Carácter y Educación Emocional por la UNIR, y otro en Logística, Transporte y Seguridad Vial por la UNED. Profesor en la ETS de Ingeniería Civil (UPM), profesor asociado de la Facultad de CC. Matemáticas (UCM) y del Máster de Ingeniería Matemática y Computacional de la ETS de Ingeniería y Tecnología (ESIT) de UNIR). Investigador del Instituto de Transferencia e Investigación (ITEI) del Vicerrectorado de Transferencia de UNIR. Investigador en áreas como, por ejemplo, inteligencia artificial, probabilidad y estadística, inferencia bayesiana y modelización, optimización y simulación de redes. Más de 20 años de experiencia en consultoría e ingeniería de infraestructuras, participando y/o dirigiendo proyectos nacionales e internacionales en diferentes países.

Los capítulos anteriores de la serie:

- Cómo detectar y prevenir el odio en los medios de comunicación digitales a través de Hatemedia.

- El abecé de la desinformación y el odio: claves para entender y combatir las amenazas digitales.

- Las mujeres que ocupan cargos políticos, principales destinatarias del odio en las redes sociales.

- Odiadores en las redes: cómo operan, se organizan y afectan a la opinión pública.

- Algoritmos y técnicas de IA para la detección y clasificación del odio en las redes sociales y los medios.

Consulta aquí la última entrevista a Elías Said-Hung publicada en UNIR Revista.

- Escuela Superior de Ingeniería y Tecnología

- Facultad de Educación

- Facultad de Empresa y Comunicación